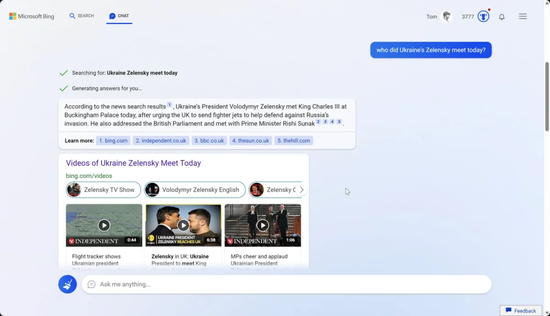

2月25日消息,不久前,谷歌在内部发起了代号为“斗狗”的活动,要求公司所有员工每周用两到四个小时帮助测试和改进其新的人工智能搜索聊天机器人Bard。就在Bard发布前不久,微软也刚刚发布了采用ChatGPT聊天机器人背后技术的新版必应搜索引擎,它允许用户就几乎任何话题进行多轮对话。

然而,在Bard被发现提供了一个错误的答案后,对于谷歌的质疑也逐渐浮现。同样,随着越来越多的人测试了新必应,他们的聊天机器人也遇到了问题,比如其倾向于好斗的行为。

像Bard和ChatGPT这样的AI聊天机器人,可以通过接受人类编写的文本训练来模仿人类对话,这就解释了为什么必应的回复有时候看起来有些情绪化和不可预测。毕竟,被训练得像人一样的机器人也很容易犯下人类的错误。

这些聊天机器人最初通过摄取大量的训练数据来完成大部分学习。此外,Bard项目的产品主管杰克·克劳奇克(Jack Krawczyk)在一份备忘录中告诉员工,谷歌的研究发现,为用户查询添加高质量的响应“显著”提高了其AI模型的质量。

据多位AI专家透露,谷歌员工可能会为Bard编写高质量的答复以改进其模型。这些专家已经在AI和大型语言模型领域完成了广泛的研究。

克劳奇克让员工向Bard询问他们擅长的领域,比如最喜欢的兴趣爱好。然后,他们被要求评估Bard的答案,以确保这些答案符合人们的期望,长度和结构也都要合理。如果某个答案过于人性化、存在事实错误或者没有任何意义,员工可以重写答案并提交给Bard的模型训练。

英属哥伦比亚大学计算机科学助理教授韦德·施瓦茨(ved Shwartz)表示,要想持续改进Bard,谷歌可以采取监督式学习和强化学习相结合的方式。

其中,监督式学习是第一步,研究人员可以向聊天机器人输入人类编写的查询和答案,直到它学会如何像人类那样回复。在此基础上,谷歌可以构建一个强化学习模型,用谷歌员工写的答案来训练它,以帮助它理解该公司希望Bard的答案展现哪些价值观,包括在结构、语气以及其他方面加以改进。

这个强化学习模型会查看Bard给出的答案,剔除其中不合适的答案,并验证合格的答案,直到聊天机器人明白它应该如何行事。基本上,来自谷歌员工的“正确”答案将帮助该模型改进。

强化学习模型还可以教会Bard在不谈论情感或以其他方式假装人类的情况下提供信息。第一种模型主要学习基本的写作技巧,而第二种模型将引导机器按照预期的方向回答问题。

哥伦比亚大学计算机科学教授周宇(音译)说,有了足够好的答案进行分析,强化学习模型就能知道哪些是合适的答案,哪些是不合适的答案。

确保事实准确性

谷歌始终对推出聊天机器人持谨慎态度,可能是因为其可能对搜索业务利润产生短期影响,并担心准确性。谷歌要求员工拒绝回答Bard试图就金融或健康等敏感话题向用户提供建议的问题,因为回答错误的风险很高。

AI领域始终在努力解决事实准确性问题,OpenAI在1月份发布了更新,以提高ChatGPT在各种话题上对话的准确性。本月在旧金山举行的一场关于聊天机器人和AI的会议上,Anthropic首席执行官达里奥·阿莫代(Dario Amodei)表示,他相信随着模型的改进,聊天机器人将不再编造事实。

虽然训练有助于提高聊天机器人所生成答案的质量,但施瓦茨表示,她不认为这能够彻底解决事实准确性的问题。Bard和ChatGPT都有所谓的“幻觉”倾向,这是该行业用来形容聊天机器人编造事实的术语。它们会从网页上提取内容,有时不可避免地会错误地总结这些内容。(小小)