惊艳众人的Vision Pro竟偷偷装了“脑机接口”?苹果Vision Pro的横空出世,一夜之间在全球引起轩然大波。正如库克所称,这将开启“空间计算”时代,足见Vision Pro对所有人来说意义非凡。戴上Vision Pro,只需眨眨眼,捏合手指,甚至动动嘴,“头号玩家”的科幻便成为可能。

但,苹果Vision Pro的科幻感,不仅于此。

头显发布后,苹果前研究员Sterling Crispin在Twitter回顾自己工作中,透露了不少关于Vision Pro的“黑科技”。

最让人惊艳的是,Vision Pro其实还暗藏着一种“脑机接口”技术。

不需要芯片植入,它就能预测你的大脑行为,妥妥的“读心术”。

灰色框可能是苹果在搞秘密的项目

此外,苹果头显还能根据个人身体和大脑的数据,来检测心理状态。

看似篇幅不长的推文中,其实给许多人对苹果Vision Pro带来了无限的畅享。

Vision Pro暗藏“脑机接口”?

2108年,Sterling Crispin加入苹果技术开发小组,担任“神经技术原型”的研究员。

3年前,他开始参与Vision Pro的研发工作。

正如他在Twitter上所称,自己花费人生10%的时间为Vision Pro的开发做出贡献,这是我做过的最长的一次努力。

Crispin在苹果的大部分工作都受到保密协议的约束,设计广泛的主题和方法。

但其实,这些工作,有些苹果已经申请了专利,可以拿出来讲。

Crispin称,“要使特定预测成为可能,涉及很多技巧,我提到的少数专利对此进行了详细说明。”

最酷的能力就是能够预测用户,会在他们实际点击之前,点击某些东西。

而这项技术背后的主要原理是,每个人在做每件事之前,瞳孔会做出反应,其中部分原因是你预计在你点击之后会发生一些事情。

因此,苹果可以通过算法来监视你的眼睛行为。

并实时重新设计UI,以创建更多这种预期的瞳孔反应,从而创建个人大脑的生物反馈。

这其实就是通过眼睛实现的初级“脑机接口”。

Crispin表示,“这是一项艰巨的工作,也是我引以为豪的事情。随时都会接受侵入性脑部手术。”

从中可见,苹果头显利用大量神经科学技术来开发其中的一些关键功能,凭借不同技巧来确定一个人将要做的事。

此外,Crispin称自己工作很大一部分,涉及通过用户在沉浸式体验中的身体和脑部数据,来检测用户的心理状态。

毕竟沉浸在虚拟世界中的人们,真的很需要有个健康检测的功能。

当你处在混合现实,或者虚拟现实体验中,AI模型尝试预测你是否感到好奇、思维漫游、害怕、注意力集中、记起过去的经历或其他认知状态。

而这些都可以通过眼动追踪、脑部电活动、心脏跳动和节奏、肌肉活动、大脑中的血液密度、血压、皮肤电导等测量数据来推断。

除了以上提到的技术,推测认知状态还包括你可能察觉不到的方式。

比如,向你快速闪烁视觉效果,或者声音,然后测量你对此的反应。

还有一项专利介绍了,如何使用机器学习,以及来自身体和大脑的信号来预测你的注意力、放松程度或学习情况。

然后,头显会自动更新虚拟环境,以增强这些状态。

因此,你可以想象一个自适应沉浸式环境,它可以通过改变你在背景中看到和听到的内容,来帮助每个人学习、工作或放松。

Sterling Crispin介绍的这些和科技,或许我们能够在VisionPro未来迭代升级中看到。

背后部分专利一览

支撑发布会上魔幻演示的效果的,是苹果在默默开发VR设备这么多年中自己的技术积累。

5000多项VR专利,是发布会上惊艳众人产品和基石和护城河。

现在就来看看演示中涉及到的专利技术。

双手+意念控制一切

市面上几乎所有的VR设备都配备了手柄。

但是苹果却大胆的在自己的第一款VR产品中就完全依赖手势追踪和眼球追踪实现了丝滑的控制效果。

背后的技术在2023年获得了专利。

根据专利图示,FIG.1是3D操作环境的框架图,展示了用户UI实现的整体框架。

FIG.4是捕捉用户的手势输入的头显计算机系统的手部跟踪单元的框架图。

FIG.5是用户的眼球追踪数据输入的头显计算机系统的眼睛跟踪单元的框架图。

这个专利图例展示了眼球反光辅助眼球追踪的流程图。

除了提供手部和眼球追踪技术的基础之外,该专利还描述了用户如何在3D环境中更有效的进行交互的设计和流程。

强大的手势追踪体验,还源于今年5月,苹果又获得了一项专利。

这项专利描述了头显中的摄像头如何使用深度映射来区分不同的手势。

图注:FIG.7E/F/H/I 说明了相对于三维环境,基于用户在一系列用户输入期间保持的手握力从而有选择地移动虚拟对象或相对于三维环境(以及三维环境中的所有虚拟对象)移动视点维度环境。

一键生成3D形象

还记得之前被全网嘲讽的小扎在Horizon World里的3D形象吗?

苹果给出了的方案也许部分解释了为什么同样是做VR设备,苹果能引爆全网,Meta却让自己的股票“跌跌不休”。

背后的技术专利也在上周被公布出来。

这个专利描述了未来的 Apple Watch 和 XR 头显将允许用户使用设备上的相机设置自己的 3D 头像的技术。

在专利的示意图中,苹果展示了未来的 Apple Watch允许用户使用 Apple Watch 背面的传感器拍摄自己的 Face ID 图像。

该传感器技术同样可用于XR环境。

无限画布

苹果发布会上演示的Vision Pro可以将周围空间作为无限画布。

用户不仅可以随意使用任何APP,而且可以把它们调成喜欢的任意尺寸。

苹果在 2018 年就申请了和这个功能相关的专利,这项技术让未来的XR头显提供用户在 3D 环境中编辑文档的功能。

如下图 Apple 的专利图所示。

另一个相关专利是2021年获得的让佩戴XR头显设备 (HMD) 的用户可以查看显示器(Mac、MacBook 或电视)并根据需要进行虚拟扩展的技术。

收购AR初创公司Mira

其实,从申请多项专利可见,苹果在AR/VR领域的探索,蓄谋已久。

最早可以回溯到2010年,苹果就收购了来自瑞典的面部识别技术公司Polar Rose。

在Vision Pro推出的后一天,就传出了苹果近来收购了Mira。这是一家构建轻量级AR头显的初创公司,还为美国军方提供服务。

根据Mira首席执行官Ben Taft在Ins上的帖子显示,作为收购的一部分,苹果已经聘请了至少11名Mira的员工。为Mira在苹果的下一篇章感到兴奋。从宿舍到收购的7年旅程。

目前,具体收购金额未知,也不清楚Mira在苹果的增强现实路线图中扮演怎样的角色。

据2名前员工透露,苹果前设计主管Jony Ive曾一度担任这家初创公司的顾问。

Mira于2016年由Ben Taft创立,总部位于洛杉矶,一直在为全球客户生产AR头显,包括任天堂在日本环球影城中的主题公园。

这家初创公司迄今已筹集了约1700万美元的资金,包括蓝熊资本、幸福投资和红杉资本在内的投资者。

而苹果在Vision Pro中展示出来的很多技术,也是源于一次次成功的收购。

比如一些手势和空间定位的专利技术,就是通过收购了总部位于蒙特利尔的 VRvana获得的。

头显“iPhone时刻”到来,还需5年

苹果推出的Vision Pro,预示着它的下一个时代即将到来。

这款头显标志着苹果首次创建了一个新的计算平台,可以取代现有的大部分主要产品。

尽管iPhone蚕食了iPod,iPad威胁到了Mac。但是,还没有哪一个苹果产品类别能够同时击败当前3个主要细分市场。

彭博报道称,想让Vision Pro成为iPhone的替代品,至少需要5年的时间。若要成为杀手级产品,可能需要付出更多的时间。

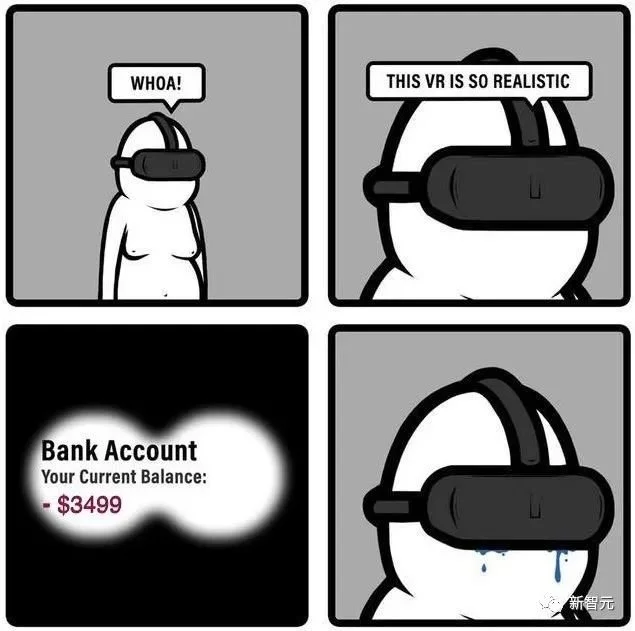

如今,Vision Pro售价3499美元,价格高且不说,不能与手机互联互通,甚至也不能打电话。

而且设计还是太过笨重,而且必须随身装一个外置电池组,仅有2小时电量,无法长时间使用。

但在接下来的几年里,苹果能够解决这些问题,并推出一款“无所不能”的设备。

表面来看,Vision Pro看起来就像是一个为有钱人,或者那些对科技新品有无限需求的人而定制的“高价玩具”。

但是,苹果在WWDC上也竭力表明,这是每个人的设备,从办公、到娱乐、视频、出行等等方面。

不过,这并非不可能。

苹果在iPhone、MacBook等产品的迭代更新向世人展示了自身的潜力。

进而,Vision Pro及其更先进的后续产品的发展价值,也将变得更加清晰。

其实还有一点是,Vision Pro并不像iPad或iPhone一样容易上手。而且每个人戴上头显还可能会有沉浸体验的不舒适感。

不过,随着时间的推移,人们便会习惯这种全新的“空间计算机”,就像戴一副眼镜一样。

通过Vision Pro,苹果展示了自己正朝着将计算设备体积缩到最小、最轻便的未来努力。

但这可能是一条漫长,而崎岖的道路。

不过,至少在周一的2个小时里,对于数百万果粉来说,这款头显让他们终于见证了Vision Pro的到来。

或许有一天,我们可能会戴着Vision Pro,观看WWDC 2030。